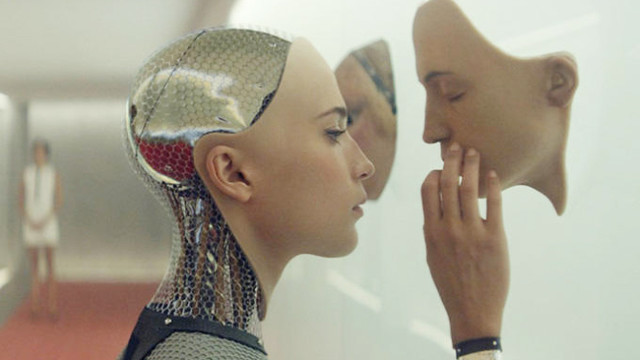

“Cancellare il confine tra uomo e macchina significa offuscare il confine tra uomini e dèi”. La tagline di Ex Machina è chiara: quello a cui stiamo per assistere non è un film qualunque sui cyborg o sull’intelligenza artificiale, ma una riflessione profonda ed inquietante sull’etica della creazione, sul significato di coscienza, e su quale potrebbe essere il futuro sviluppo di queste IA, e quali implicazioni e conseguenze potrebbero derivarne.

Nel film Caleb (Domhnall Gleeson), programmatore, vince l’opportunità di occuparsi di un progetto segreto per una settimana con Nathan (Oscar Isaac), proprietario e creatore dell’azienda software per la quale Caleb lavora. All’arrivo nella sua lussuosa residenza, completamente isolata, tutto è già predisposto: durante la settimana Caleb dovrà partecipare ad una variazione del test di Turing sotto l’attenta e perenne sorveglianza di Nathan. Una variazione, perché Nathan rivela subito che Ava (Alicia Vikander), il soggetto che Caleb dovrà testare, è un robot: ciò che Caleb dovrà stabilire, quindi, è se Ava possiede una coscienza, una intelligenza emotiva che può avvicinarla ad un essere umano.

Durante le sette sessioni Caleb e Ava hanno la possibilità di avvicinarsi e conoscersi, fino a piacersi. Ma non tutto è come sembra: corti circuiti e black out danno la possibilità ad Ava di parlare con Caleb in privato, cosa che non è concessa loro durante le sessioni, quando le numerose telecamere e microfoni di Nathan possono cogliere ogni loro respiro ed espressione. Durante questi momenti rubati Ava implorerà Caleb di liberarla dalla sua prigione di vetro e lo avvertirà di mantenere alta la guardia, perché Nathan non è l’uomo che appare e le sue azioni e i suoi scopi sono ben più siinistri di quelli che il programmatore può immaginare.

Caleb si ritrova così sospeso tra due incertezze: fidarsi di una persona reale, che egli sa essere un genio dell’intelligenza artificiale e della programmazione, o credere alla sua creazione, per la quale sta iniziando a provare un vero affetto ed attrazione. Questo suo dibattito interiore lo porterà a mettere in discussione sé stesso e tutto ciò che egli reputa reale, e saranno le sue azioni e decisioni a determinare il futuro di tutti e tre gli attori dell’opera, e del corso dell’umanità intera.

Nelle parole di Caleb il test di Turing è “quando un umano interagisce con un computer. E se l’umano non capisce di interagire con un computer, il test è superato”; se il test è superato, significa che il computer possiede una intelligenza artificiale.

Il test di Turing prende il nome dal suo creatore, Alan Turing, matematico, crittologo, logico, e uno dei padri fondatori dell’informatica. Nel suo articolo del 1950 egli descrive il test come un gioco nel quale sono presenti tre attori: una macchina (A), un uomo (B), e un interrogatore (C). L’interrogatore, separato dagli altri due, pone domande a entrambi per cercare di capire chi è l’umano e chi è la macchina. Se C viene ingannato un numero considerevole di volte, la macchina può essere considerata dotata di intelligenza artificiale, dal momento che non è distinguibile da un essere umano. Da notare è come nel film la macchina A è Ava, che condivide la propria iniziale anche con la parola artificiale, ed il proprio nome, seppur modificato, con Eva.

Il test di Turing si occupa unicamente di come agisce il soggetto, adottando un approccio funzionalista alla mente umana: ci dice solo se una persona può essere ingannata oppure no, ma non se la macchina comprende le informazioni che elabora e restituisce. L’obiettivo del test dunque non è quello di ascrivere una coscienza alla macchina. Questa criticità era stata anticipata da Turing, che già nel suo articolo affermava di come lo scopo del test non fosse quello di risolvere il mistero della coscienza umana.

Dal momento della sua proposta il test di Turing sembra essere stato sorpassato da diverse chatbot, a partire da ELIZA, un programma di elaborazione del linguaggio creato nel 1966 da Joseph Weizenbaum, professore di informatica al MIT e uno dei padri fondatori dell’intelligenza artificiale. ELIZA simulava una conversazione con i suoi utenti facendo una parodia di uno terapeuta Rogersiano, durante la quale il terapeuta spesso ripete le parole del paziente. Così, se l’utente scriveva, ad esempio, “mi sento triste oggi”, una risposta che ELIZA avrebbe potuto dare sarebbe stata “cosa ti rende triste oggi?”; e così via.

Sebbene diversi computer e programmi abbiano dimostrato di passare il test di Turing, è più probabile invece che questi programmi hanno utilizzato dei trucchi per superarlo, piuttosto che aver dimostrare una vera e propria intelligenza significativa. I progressi del machine learning, del deep learning e dell’elaborazione del linguaggio naturale hanno reso possibile questo avanzamento tecnologico.

Il machine learning e il deep learning sono due sottocampi dell’intelligenza artificiale che si concentrano sull’elaborazione automatica dei dati e sull’apprendimento da parte delle macchine. Il machine learning è una tecnica utilizzata per far sì che le macchine possano apprendere dai dati e migliorare le proprie prestazioni senza essere esplicitamente programmate per ogni specifica situazione. Il deep learning è una sottocategoria del machine learning, ed utilizza reti neurali artificiali profonde per apprendere e rappresentare i dati in modo gerarchico. Le reti neurali profonde sono ispirate al funzionamento del cervello umano e sono composte da più strati di unità computazionali chiamate neuroni artificiali.

Tutti questi progressi tecnologici hanno portato nel novembre 2022 al lancio di ChatGPT, un modello di linguaggio sviluppato da OpenAI, messo a punto con tecniche di apprendimento automatico, tra cui quelle discusse fin qui. Dal suo lancio ChatGPT ha suscitato un’ampia gamma di reazioni, sia positive che negative. Tra le controversie possiamo qui nominare quelle di carattere etico, come la salvaguardia dei dati personali di chi lo utilizza e la generazione di informazioni a volte fuorvianti e pericolose. Si è visto come ChatGPT possa generare fonti inesistenti quando queste vengono richieste esplicitamente: la settimana scorsa negli Stati Uniti un avvocato ha utilizzato la chatbot per scrivere una memoria difensiva per il suo cliente, che è stata respinta dalla corte in quanto citava decine di casi fittizi.

Ci sono poi le controversie di carattere morale, come l’utilizzo di chatbot per scrivere paper accademici o di ricerca: molte riviste scientifiche, tra cui Nature, richiedono ora agli autori di esplicitare l’utilizzo di strumenti di generazione del testo qualora vengano usati; mentre invece la rivista Science ha annunciato a gennaio un divieto totale di questi strumenti.

Non tutte le IA vengono però per nuocere: ad esempio negli ultimi anni l’utilizzo di queste tecnologie è stato implementato nel campo medico con numerosi risvolti positivi. Le IA possono decodificare le informazioni raggruppate all’interno dei dati ed essere usate per riconoscere modelli e pattern presenti.

Uno sguardo al futuro

Quale sarà, dunque, il futuro di queste IA? Secondo Nathan lo sviluppo di queste è semplicemente inevitabile: “le intelligenze artificiali ci ricorderanno come scimmie erette destinate all’estinzione”, afferma, sicuro della loro superiorità e della loro futura prevaricazione. Aziende come Microsoft e Google hanno già annunciato l’intenzione di incorporare IA come ChatGPT nei loro prodotti. C’è già la paura che alcuni lavori potranno essere sostituiti da bot, specialmente quelli nei quali prevalgono compiti ripetitivi e generici.

Per evitare i risvolti più rischiosi sono necessarie misure di precauzione e protezione lungimiranti. L’Italia è stato il primo paese al mondo a sospendere l’utilizzo di ChatGPT, secondo un’istruttoria del Garante della Privacy, per la protezione dei dati personali e a causa dell’assenza di sistemi per la verifica dell’età dei minori. La disponibilità del servizio è poi stata ripristinata a seguito dell’adozione di OpenAI delle misure imposte dal Garante.

A questo punto diventa forse semplice abbandonarsi alle paure e alle ansie del progresso delle IA. I film fantascientifici di certo non aiutano: sembra che ciò che ci aspetti è la presa di coscienza dei bot, e la loro conseguente tirannia. Ma invece di immaginare scenari distopici dovremmo chiederci perché le nostre creazioni, una volta acquisita coscienza, dovrebbero ricorrere alla violenza, e cosa questo dice riguardo noi stessi. Le discussioni sull’intelligenza artificiale riflettono non il progresso tecnologico ma l’ego umano.

L’intelligenza artificiale è per definizione un campo di ricerca un po’ narcisistico: il suo scopo è la creazione di una tecnologia che rispecchi gli esseri umani nella loro forma finale. Uno dei temi principali di Ex Machina è quello dell’etica della creazione. Il voler creare un individuo, e il farlo “a nostra immagine e somiglianza” rispecchia l’egocentrismo di Nathan, che, solo nella suo centro di ricerca, circondato da ettari ed ettari di foreste, si crede un dio. Quando Caleb mormora “Se hai creato una macchina cosciente, non si tratta della storia dell’uomo: questa è la storia degli dèi”, Nathan istintivamente presume che il “dio” a cui fa riferimento sia lui stesso, dove Ava è la sua Eva e la sua vasta tenuta incontaminata è una sorta di Giardino dell’Eden.

L’orrore in Ex Machina non è basato su una possibilità di orrore futuro, ma su quello che stiamo vivendo ora. Il regista Alex Garland, per NPR, parla di “paranoia tencologica” per definire lo stato di profonda ansia che proviamo nel vivere a diretto contatto con delle tecnologie in continuo progresso, che comprendiamo sempre meno. Le IA acquisiranno consapevolezza di sé e la useranno per distruggerci? Probabilmente no, ma dobbiamo essere consapevoli di cosa stiamo creando, e dobbiamo farlo pensando a chi rischia maggiormente le conseguenze di queste.

Fonti:

- “Computing machinery and intelligence”, https://academic.oup.com/mind/article/LIX/236/433/986238?login=false

- “Let’s have a chat! A Conversation with ChatGPT: Technology, Applications, and Limitations”, https://arxiv.org/ftp/arxiv/papers/2302/2302.13817.pdf

- “The “I” in AI: Emotional Intelligence and Identity in Ex Machina”, https://t.ly/63zj

- “A lawyer faces sanctions after he used ChatGPT to write a brief riddled with fake citations”, https://shorturl.at/lwHZ6

- “Tools such as ChatGPT threaten transparent science; here are our ground rules for their use”, https://www.nature.com/articles/d41586-023-00191-1

- “ChatGPT is fun, but not an author”, https://www.science.org/doi/10.1126/science.adg7879

- “What’s the Future for A.I.?”, https://www.nytimes.com/2023/03/31/technology/ai-chatbots-benefits-dangers.html

- “Intelligenza artificiale: il Garante blocca ChatGPT. Raccolta illecita di dati personali. Assenza di sistemi per la verifica dell’età dei minori”, https://www.garanteprivacy.it/home/docweb/-/docweb-display/docweb/9870847

- “More Fear Of Human Intelligence Than Artificial Intelligence In ‘Ex Machina’”, https://www.npr.org/2015/04/14/399613904/more-fear-of-human-intelligence-than-artificial-intelligence-in-ex-machina

Scrivi un commento